Что лучше 2 видеокарты или 1 мощная

Преимущества и недостатки двух разных видеокарт на одном компьютере

Установка двух или более видеокарт, работающих совместно, обеспечивает улучшенную производительность видео, 3D и игр по сравнению с одной видеокартой. Как AMD, так и Nvidia предлагают решения для работы с двумя или более видеокартами, но чтобы решить, стоит ли принимать это решение, нужно рассмотреть требования и преимущества.

Требования к системе с двумя видеокартами

Преимущества

Недостатки

Большим недостатком двух видеокарт в одном компьютере является стоимость. Поскольку топовые видеокарты уже стоят 500 долларов и более, многим потребителям трудно позволить себе вторую. Хотя ATI и Nvidia предлагают более дешевые карты с поддержкой двух карт, зачастую лучше потратить одинаковое количество денег на одну карту с одинаковой или иногда лучшей производительностью, чем на две недорогие.

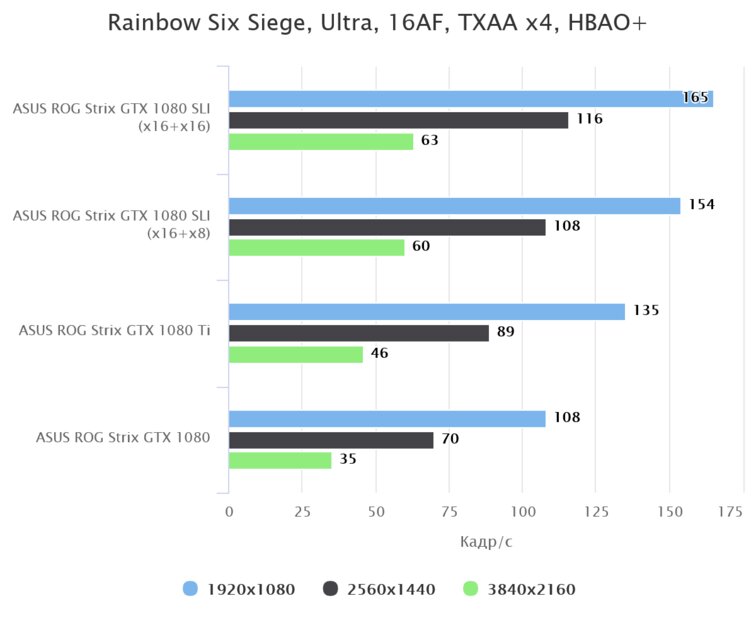

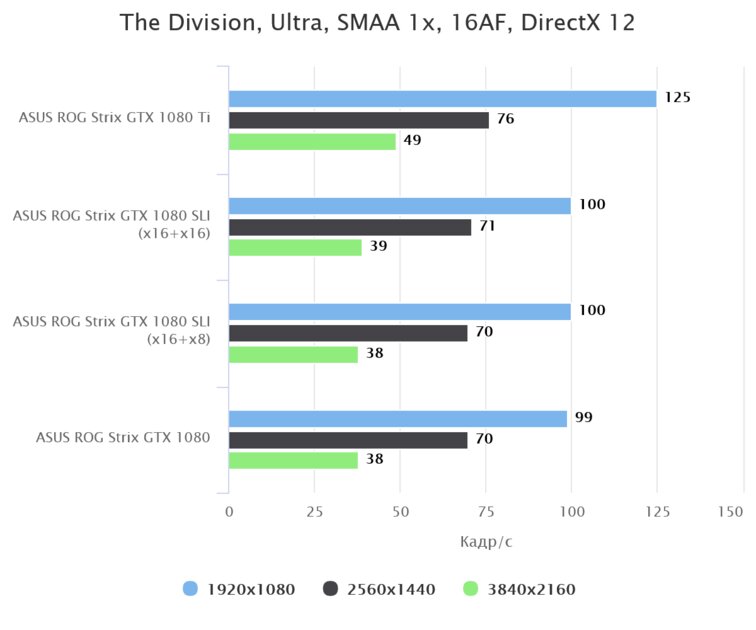

Другая проблема заключается в том, что не все игры выигрывают от нескольких видеокарт. Эта ситуация значительно улучшилась с тех пор, как были представлены первые настройки с двумя картами, но некоторые графические движки по-прежнему плохо справляются с двумя видеокартами. Фактически, некоторые игры могут показывать небольшое снижение производительности по сравнению с одной видеокартой. В некоторых случаях происходит поддергивание, из-за которого изображение видео выглядит прерывистым.

Современные видеокарты очень энергоемки. Наличие двух из них в системе может почти удвоить количество потраченой эллектроэнергии, необходимое для их запуска в тандеме. Например, для правильной работы одной видеокарты высокого класса может потребоваться блок питания на 500 Вт. Наличие двух таких же карт может потребовать около 850 Вт. Большинство настольных компьютеров не оснащены такими мощными блоками питания. Обратитесь к мощности вашего компьютера и требованиям, прежде чем покупать более мощное оборудование.

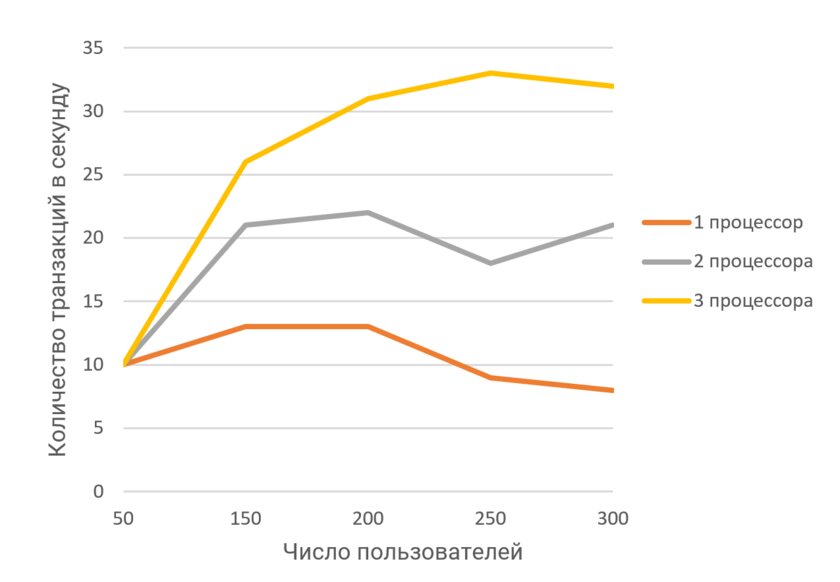

Преимущества производительности в среде с двумя картами зависят от других компонентов компьютерной системы. Даже с двумя графическими картами самого высокого класса процессор нижнего уровня может регулировать объем данных, которые система может предоставить графическим картам. В результате двойные видеокарты обычно рекомендуются только в высокопроизводительных системах.

Кто должен установить две видеокарты?

Для среднего потребителя запуск двух видеокарт не имеет особого смысла. Общие затраты на материнскую плату и видеокарты, не говоря уже о других основных аппаратных средствах, которые необходимы для обеспечения достаточной скорости графики, являются непомерно высокими. Однако это решение имеет смысл, если вы хотите запускать игры на нескольких дисплеях или в экстремальных разрешениях.

Начало Эры Multi-GPU видеокарт или когда две головы лучше одной

реклама

Кто ответит на вопрос «Почему?» Возможно, индийские программисты устали писать код, а возможно коронавирус этому помешал, а может производители игр не хотят заниматься дальнейшей поддержкой этой технологии? Сплошные вопросы, не так ли? Но, наш клуб с экспертами-комментаторами, я уверен, прольет свет и ответит на эти и другие вопросы.

А пока сходим в техническую библиотеку отдела Nvidia. Где-то лет 20 назад, почитаемая компания номер 1 в 3D графике приказала долго жить. И Nvidia купила ее, а заодно все её наработки и патенты. Олдфаги, догадались, что речь идет о 3DFx. 3DFx была первой компанией, которая дала миру SLi!

реклама

Одна вторая «Вуду» тянула лишь 800 на 600. Вот, тогда польза от второй видеокарты была как раз осязаема, реальна нужна. А что сейчас делать с парой RTX 3090? Хороший такой вопрос, но оставим его без ответа, на совесть владельцам RTX 3090, я думаю они появятся в обсуждении и всё нам расскажут. Я пока сижу на встройке и о RTX 3090 могу лишь мечтать, как и 99% всех, кто сюда забрел.

Итак, Nvidia купила 3DFx и получила доступ к технологии SLi. Я рассказываю по-простому, на самом деле технология построения изображения у обоих компаний в корне отличались, но для обывателя они называются одинаково и в обоих случаях обе видеокарты соединяются физически с помощью гибкого мостика, шлейфа или перепаянного куска кабеля от «флоппика». И после этого в недрах самой «зеленой» компании родился «План Б» по захвату всего рынка 3D ускорителей. Пока ATI сидела и курила нервно в сторонке, гибкие мостики окутывали умы инженеров Nvidia и маркетологов. И вот тот день настал!

реклама

А если к этому добавить смену molex коннекторов на специальные 6-pin коннекторы для видеокарт, то и на все 100%. В то время изможденные геймеры, со старыми блоками питания, бродили по компьютерным рынкам в поисках переходников molex-6pin. Тогда еще не было AliExpress и засилья китайским мастеров. Я сам ждал свой коннектор для новой видеокарты 3 дня!

реклама

Местные предприниматели его вытащили из коробки и видимо потом перепродали. В общем, проблем стало у всех как минимум на одну больше. А все из-за 3Dfx, которая протянула неожиданно ноги. Хитрые игроделы, получив допинг от известной компании сразу же заявили, что их игры будут работать быстрее в 2 раза, главное — это купить эту лицензионную игру и вторую видеокарту.

Любители помериться попугаями в тестовых бенчмарках тоже побежали покупать вторую видеокарту, ведь нужно больше золота, очков в итоговом окошке теста. В общем, как ни крути, но вторую видеокарту каждый порядочный энтузиаст был обязан купить. В то время, я был в Швеции и собственноручно видел, как сметали с прилавков магазинов новенькие 6600GT и 6800GT. Сейчас можно вспомнить аналогию очередей за Iphon’ами, хотя это скучно, ведь зачем покупать второй «Айфон»? Звонить самому себе? Я лучше побеседую с Siri.

В день анонса было разбито несколько тысяч бутылок шампанского и детских мечт. Обзорщики плакали и рыдали, ведь им посчастливилось прикоснуться к святому Граалю, квинтэссенции бытия 3D и просто хорошей видеокарте с двумя GPU на борту. Но был, как всегда, один нюанс. О котором не сочли нужным все рассказать и те пользователи, которые купили эту видеокарту, потом остались без ногтей.

Они из загрызли их до дыр. А все потому, что это волшебная видеокарта могла работать только на паре моделей материнских плат Gigabyte. Опять горе и слезы. Но главное ведь продать, а пользователи сами потом разберутся. Естественно, в мануале все было написано, но наши люди сначала делают, а потом читают. Я и сам так иногда делаю, чего скрывать.

В общем все обзорщики похвалили инициативу Gigabyte, пожали руки и разошлись, захватив с собою шампанское. А Pr-отдел гигабайта не сидел сложа руки, в недрах секретной лаборатории кипела работа над двойной 6800 GT! Черт побери, это даже круче чем сейчас одна RTX3090. И они это сделали! Так появилась Gigabyte 3D1 6800GT Dual. Это по истине царская карта взгляните сами.

За эту карту не грех и почку было в то время отдать. Внешний респектабельный вид, радиатор в позолоте, уникальный дизайн и голубой текстолит, все говорило, что к хозяину такой карты без стука лучше не подходить. Если вы проникните в его жилище чтобы хотя бы одним глазком посмотреть на этот шедевр инженерной мысли, если он вас сам не убьёт, то вас точно загрызет его собака. Поэтому нужно сначала стучаться.

Для более простых энтузиастов или младших братьев обладателей Gigabyte 3D1 6800GT Dual, компания Gigabyte выпустила младшую модель на базе двух GPU 6600 без суффикса GT. Ну а что, всё правильно, каждому брату по видеокарте. Называлась такая видеокарта Gigabyte 3D1 XL 6600 Dual.

Алло Асус? Срочно зайдите в ординаторскую, пациенту плохо! У него неизлечимая SLi-зависимость и срочно нужно видеокарто-вмешательство. Да вы не ослышались, чтобы было делать реальным пацанам с мамками не от Gigabyte? Не менять же свой топ и не изменять своему любимому бренду! А таких было много, головные боли не могли излечить даже в Pr-отделах многих компаний. Но, как всегда, нашлись спасители, кошельков и душ страждущих.

Размеры этого монстра приводили всех в шок, таких видеокарт тогда еще не видел никто! Все были в шоке, даже отец одного школьника, которого развели на эту «дуру». Мало того, что она не вмещалась в системный блок, так и старенький блок питания уходил в защиту и ни при каких обстоятельствах не выходил из неё. Пришлось покупать новый корпус и блок питания, ну а что делать, обратного пути уже не было. В комплекте к видеокарте шел специальный SLI переключатель, который позволял этой видеокарте работать, где пожелает её повелитель.

Темный кожух, приставка Extreme, на коробке сам Посейдон или Зевс, ну что еще нужно? Правильно – вторую такую! Но пока еще производители не решили эту проблему, поэтому такая видеокарта стояла в системнике в гордом одиночестве.

Сейчас сюда могут набежать многочисленные Павлики и Кириллы комментаторы, и вставить жестко свои 5 копеек, но я вам отвечу, коли SLi тогда не пробовали, не стоит и сейчас на форуме размазывать. Едем дальше. Прогресс набирал обороты, Nvidia выкатила 7000-ю серию видеокарт. Как же все обрадовались, я помню салюты возле дома. Даже один бомж спросил: «Вадим, а что за праздник?». Я говорю – Володя, это геймеры радуются. Владимир Сергеевич тогда не понял, кто такие эти геймеры, он грязно выругался и полез обратно в коробку из-под холодильника. Вот так у нас встретили новую линейку видеокарт.

В качестве ядерного реактора выступал внешний блок питания видеокарты. Инженеры из ASUS пожалели бедных отцов геймеров, теперь их старые блоки питания не боялись работать в системе с такой видеокартой. Но теперь страх был у мамы. А причем тут мать? Да при том, что чадо требовало купить эту видеокарту, а в ASUS посчитали, что только 2000 геймеров смогут ее получить, так-как она вышла в серии Limited Edition. В Pr-отделе ASUS придумали новую маркетинговую стратегию, которая в последствии еще не раз всем нам аукнется.

Итак, все матери геймеров, сплотились в одну организацию противодействия секте Liminte Edition, но ничего не вышло. Демократия она такая.

Пока они ходили с транспарантами, пара мамаш подсуетилась и купила своим 20-ти летним сыночкам сразу по паре видеокарт. Зачем? А затем, что эти две видеокарты можно было объединять в SLi, хотя соединительного мостика они не имели! Вот сюрприз, так сюрприз, а ведь многие этого и не знали. Хотя за полтос данную инфу продавали бабки в одном переулке.

Когда геймеры видели такой скриншот, они прятались под стол. Ведь такого вообще быть не могло. Но теперь даже вы знаете, что это возможно! Это и есть та магия Voodoo 😉

А результаты от игры в FEAR могли и вовсе сделать не подготовленного геймера очень нервным человеком, я сам даже боюсь смотреть на эти цифры после полуночи, а ведь тогда было еще страшнее.

Кто захочет испытать страх, сможет эту табличку и другие такие найти на THG.ru А потом все проснулись и выключили телевизор. Утром следующего дня Мир был уже не таким, как раньше. В Nvidia подумали, а почему они ходят в магазин, а сливки со сметаной все время достаются соседскому коту? Ну вы поняли, речь идет о своей прибыли. Почесав за ухом и щёлкнув пальцами, на свет была произведена по истине первая реальная DUAL-GPU видеокарт NVIDIA 7900 GX2 от самой основательницы.

Это миф или реальность? Никто не мог понять, что это за такое изделие, похоже на слоеный бутерброд. Это видеокарта – ответила маленькая девочка, ложа в свою сумочку такую же вторую. Да, теперь официально такие видеокарты поддерживали QUAD-SLi.

Если бы тогда был изобретен майнинг, все манеры бы застрелились еще тогда, только от вида таких четырех видеокарт в одной системе, и я бы вам не надоедал со своим анализом стоимости цен на видеокарты RTX 2000 и 3000-й серии. Но история пошла по другому пути.

Потом поняв, что они ошиблись, R&D Nvidia выпустил упрощенную модель NVIDIA 7950 GX2, карта была гораздо короче, что не давало такой статусности новому владельцу. И если основным производителем NVIDIA 7900 GX2 была сама Nvidia, то NVIDIA 7950 GX2 клепали все подряд. И таинства чуда и причастности к волшебству уже никто не получал. Очень жаль.

А далее события развивались по накатанной. После NVIDIA 7950 GX2 была выпущена NVIDIA 9800 GX2. Ну а что делать, деньги то нужны всем. На этот раз бутерброд обрел пластиковый кожух, который мог превращаться в маленький гробик, если геймер не пылесосил этот кирпич два раза в неделю.

Видеокарта было очень горячей, но, к сожалению, после 8800 Ultra, это уже стало нормой. Папа иногда гладил ею свой галстук, а мама могла приготовить на ней горячие пирожки, чтобы дать их собой в школу.

На этом я поставлю жирную точку. Хотя запятая была бы более актуальна, ведь история не закончилась, но я подожду ваших гнилых помидор в свой адрес в комментариях или хвалебных од в свой адрес. И вы мне скажите, что пора завязывать или писать продолжение.

Зачем компьютеру два процессора или две видеокарты. Два лучше одного?

Многие знают о существовании возможности подключить в материнскую плату не одну, а две или даже три и более видеокарты. Опытные пользователи осведомлены, что они не суммируют свою «мощность» и не выдают двойную или тройную производительность, как бы того не хотелось. Но знали ли вы, что существуют материнские платы с поддержкой двух процессоров? Получается, что можно собрать себе два компьютера в одном, получив за цену нескольких недорогих «железок» производительность топовых ПК? Давайте попробуем разобраться в этой статье во всех нюансах подобных систем и определим, для решения каких задач они подойдут лучше всего.

Содержание

Два процессора — что, как, для чего?

Немного истории развития многопроцессорных систем

Началось все с того, что Intel разработали новую архитектуру, которую назвали системой симметричной многопроцессорности (SMP). В такой системе процессоры имеют общую память и могут использоваться как для общих задач, так и каждый по отдельности. Важной деталью таких устройств является операционная система, которая должна также являться многопроцессорной, чтобы эффективно распределять задачи по всем активным процессорам. Первым устройством, которое использовало SMP, было Burroughs D825, появившееся на свет в далеком 1962 году. Забегая наперед, могу сказать, что такая система используется и в современных многопроцессорных компьютерах.

Говоря о мультипроцессорных системах, нельзя не сказать и о прямом конкуренте Intel — AMD. Да, немногие знают, но у «красных» также был ответ на SMP. Этот ответ звучал как Athlon MP («MP», собственно, и расшифровывается как MultiProcessor). По сути, это был тот же Athlon XP, но который обладал поддержкой двухпроцессорной конфигурации, использующий протокол MOESI. Этот протокол обеспечивал «общение» процессоров не на уровне системной памяти, а через их кэш-память второго уровня. Компания, скорее всего, так и не нашла должной заинтересованности пользователей в домашнем использовании своих многопроцессорных системах, поэтому сконцентрировалась именно на серверных решениях — AMD Opteron.

Компания Intel, как не трудно догадаться, задумывала многопроцессорные системы именно для серверов, однако они нашли применение и в некоторых особо производительных моделях рабочих станций. Важным витком в истории таких систем является момент, когда Intel добавила поддержку SMP в системы на базе процессоров Pentium, разрешив создание сборок с двумя процессорами, а затем и в Pentium Pro, где уже разрешалось создать компьютер аж с четырьмя ЦП. Но, стоит сказать, что уже в Pentium II разрешено было устанавливать вновь лишь до двух процессоров.

Как и ожидалось, переход в массовый сегмент дал сильный толчок распространению многопроцессорных систем, но вот маркетологам это не особо понравилось, ведь компьютер на двух относительно бюджетных Pentium работал на уровне профессиональных рабочих станций, что сильно било по прибыли компании. После этого наблюдения, Intel отказалась от внедрения SMP в массовый сегмент и оставила ее поддержку лишь в профессиональных и очень дорогих Xeon и Opteron.

Сегодня подобные мультипроцессорные системы используются не только в серверных «монстрах», но и в домашних ПК. Такая популярность появилась не на пустом месте, ведь на том же Aliexpress можно приобрести за небольшую стоимость два хоть и БУ, но Intel Xeon, материнскую плату с двумя сокетами и серверную оперативную память, получив, примерно, за половину стоимости производительность новейших процессоров даже 11-го поколения.

Что нужно знать перед тем, как собирать компьютер с двумя процессорами

В первую очередь, нужно не забывать, что двухпроцессорная сборка изначально задумывалась под использование на производительных серверах, где используются не повседневные блоки питания, корпуса и плашки оперативной памяти, а специальные серверные. Кейс должен поддерживать установку огромной материнской платы формата EATX, реже ATX и EEB. Блок питания должен иметь поддержку двух процессоров, причем стоит учитывать, что его мощность должна быть достаточна для сразу двух Xeon, а оперативная память подходить под технические требования этих ЦП — желательно использовать именно серверную оперативную память. На материнской плате зачастую распаяны целых восемь разъемов под память, и тут важно «равномерно» заполнить оба из них. То есть установить 16 ГБ памяти в один слот и надеяться на то, что будут правильно работать оба процессора — не стоит. Зато некоторые материнские платы поддерживают установку и 2 ТБ памяти.

Кстати, материнские платы для двухпроцессорных систем делятся на два типа: серверные и для рабочих станций. Отличить их можно по звуковым интерфейсам — серверная не имеет звуковых выходов, зато только она имеет встроенное видеоядро. Большим достоинством материнок как первого, так и второго типа является большое количество распаянных разъемов SATA, однако тут же есть и недостаток: разъем под M.2-накопитель вы вряд ли обнаружите на своей плате. Тут же можно обнаружить, что двухсокетные матери имеют множество входов PCIe с довольно высокими пропускными способностями. Также, любопытный нюанс заключается в том, что вы можете использовать и один сокет из двух — это не создаст никаких ошибок или потерь производительно, при том что сохранится возможность со временем «проапгрейдить» систему.

Второй процессор нужно не забывать еще правильно охлаждать — здесь потребуется два кулера, которые должны быть достаточно мощные и небольшие по размеру, ведь они расположены довольно близко друг к другу и могут создавать нежелательный дополнительный нагрев. Идеальным решением для подобной машины будет кастомная система водяного охлаждения, но это уже дорогой, хотя и крайне эффективный, путь для энтузиастов.

Если вы пройдете все этапы сборки такой «машины», то на выходе вы получите действительно мощный ПК. Главная особенность такой сборки будет заключаться в том, что производительность обоих ЦП будет именно суммироваться. Так, если вы установили два процессора по 6 ядер и 12 потоков, то на выходе вы получите именно 12 ядер и 24 потока без какой-либо потери производительности так, как если бы вы использовали один ЦП.

Компьютеры с двумя видеокартами — мечта или пустая трата денег?

Немного истории развития систем, поддерживающих две видеокарты

История развития систем «совмещения» графических процессоров начинается в далеком 1998 году, когда компания 3dfx представила новую технологию — SLI (Scan Line Interleave — сканирование чередования строк), которая уже тогда могла обеспечить совместную работу представленных в то же время чипов Voodoo2. Она была способна «подружить» ГП не просто разных производителей, но и даже разных емкостей видеопамяти. Главной проблемой этой технологии стала ее цена — 600 долларов, а также довольно большие температуры при работе.

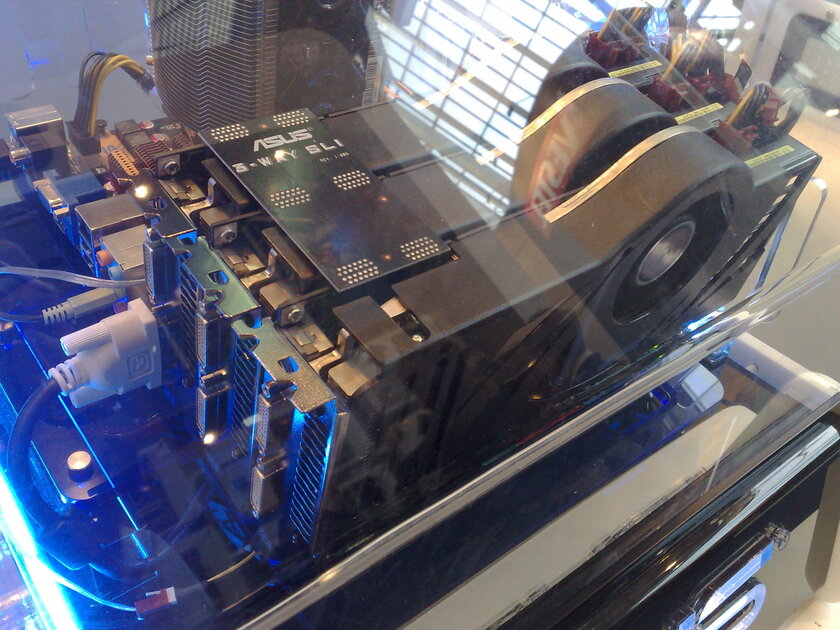

Как многие уже знают, в 2001 году Nvidia приобрела компанию 3dfx. Уже через три года был представлен PCI Express, который позволял использовать несколько графических адаптеров, а через год, после появления первых решений на базе новой технологии, Nvidia поспешила заявить о продолжении поддержки технологии SLI, но уже с новой расшифровкой — Scable Link Interface (масштабируемый интерфейс связи). В 2005 году AMD поспешила представить свою технологию, которая должна была составить конкуренцию своему «зеленому» оппоненту. Так, на Computex 2005 была представлена первая версия AMD CrossFireX. В дальнейшем оба производителя особо не изменяли принципов работы своих систем объединения видеокарт. На сегодняшний день AMD поддерживает работу CrossFireX без необходимости соединения видеокарт между собой, а Nvidia перешла на аналог SLI — NVLink Bridge, который обеспечивает более высокую производительность, но поддерживает лишь две видеокарты в одной системе. Для серии GeForce 20 RTX поддержку этой технологии имеют лишь чипы 2070S, 2080 и 2080Ti, а вот в 30-й серии — только 3090.

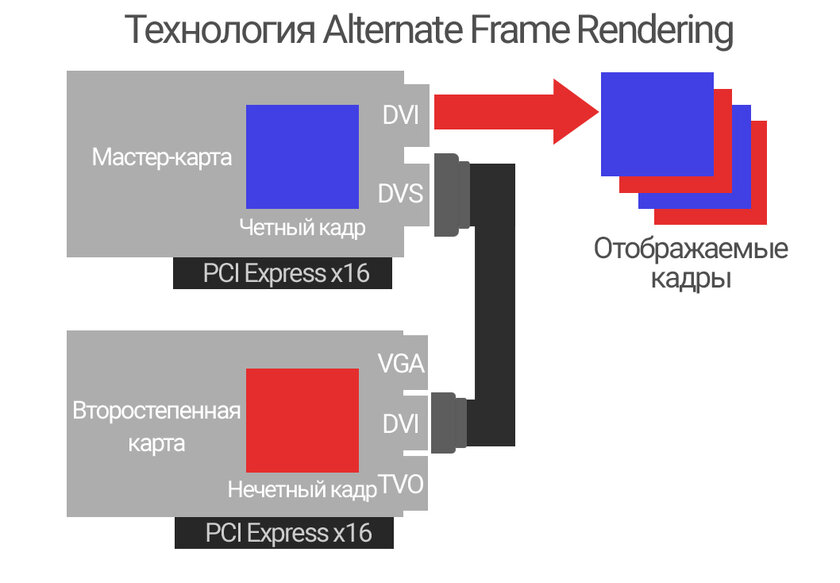

Как работает SLI и CrossFireX

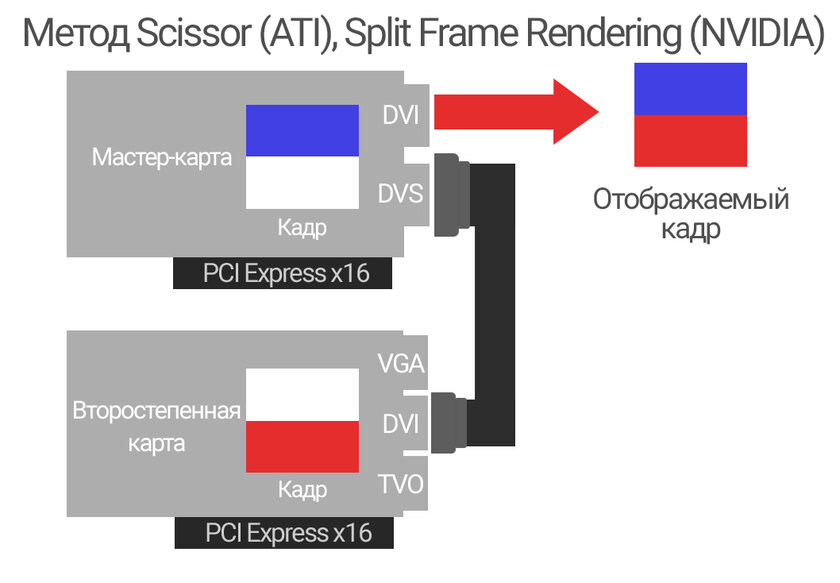

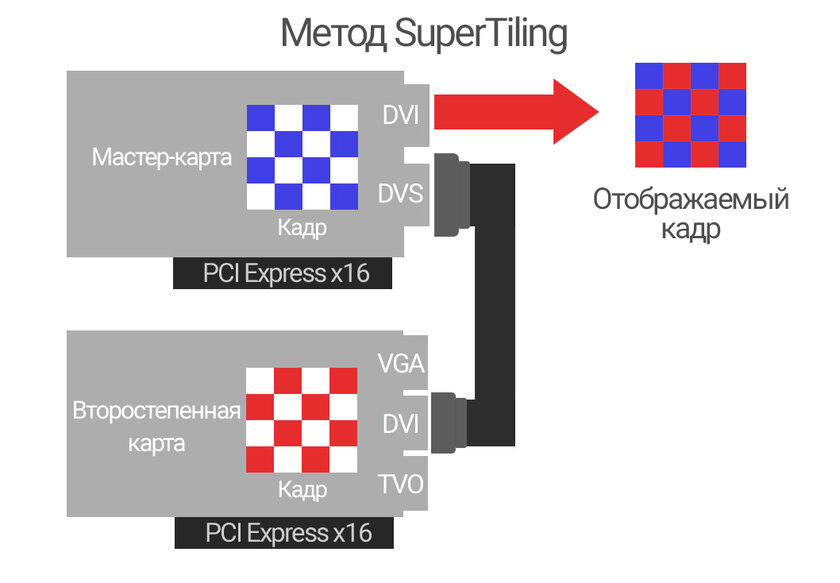

Рассмотрим несколько существующих алгоритмов построения изображений на нескольких видеокартах для обеих технологий:

Особенности использования SLI и CrossFireX

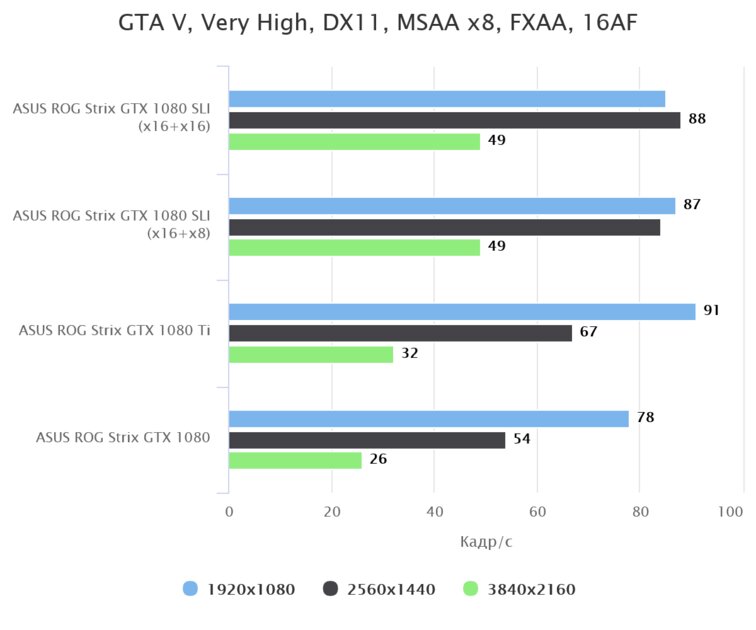

При возникновении идеи собрать себе ПК с несколькими видеокартами, необходимо еще несколько раз обдумать эту мысль и посчитать расходы. Для того, чтобы воспользоваться одной из технологий, нужно приобрести две одинаковые видеокарты, так как особенность работы SLI и CrossFireX позволяет получить на выходе производительность именно самой слабой карты. Также вам стоит позаботиться не только о том, чтобы в вашей материнской плате были необходимые входы, но и о мощности вашего блока питания, ведь теперь вам нужно снабжать электричеством целых два видеоадаптера. Не стоит забывать также, что видеокарты расположены как «бутерброд» — одна над другой, а это значит, что часть тепла от нижней карты будет переходить на верхнюю, создавая неблагоприятные условия для работы чипов.

Главной проблемой как SLI, так и CrossFireX является производительность полученной системы. Тут не как с двухпроцессорными сборками — мощность суммироваться не будет. Видеопамять в подобных системах используется как общий инструмент обеих видеокарт, поэтому логика, что «две видеокарты по 4 ГБ = 8 ГБ видеопамяти» здесь не работает. Также как и в случае с производительностью: да, чисто в теории, производительность может быть и в два раза выше, но тут встает важный нюанс — поддержку как SLI, так и CrossFireX разработчик должен организовать сам. Как правило, это делают далеко не все девелоперы, ведь доля ПК с двумя и более видеокартами крайне мала.

К слову, несколько видеокарт «в одном ПК» можно повсеместно встретить у майнеров. Но, как вы можете обратить внимание, они никак не соединены между собой. Все дело в том, что для майнинга нет необходимости правильно «отрисовывать кадры» через какие-либо алгоритмы, поэтому видеокарты подключаются просто в материнскую плату, желательно с большим количеством PCI-E портов, и начинают работу полностью друг независимо от друга. То есть, когда одна из видеокарт отказывает — остальные продолжают работу, ведь их ничего не связывает, кроме общей «матери».

Интересная мысль напоследок

Заметили, что Intel ушли со своими мультипроцессорными сборками из сегмента бюджетных решений, а Nvidia и AMD не особо улучшают свои технологии объединения видеокарт, которые застыли в 2005 году? Да, можно возразить, что сейчас вновь становятся популярны «бюджетные» сборки на двух процессорах для дома и игр, однако, если посмотреть, на каких процессорах собираются такие системы, то можно заметить, что это именно Intel Xeon, которые когда-то использовались на китайских серверах с далеких 2012-х годов, а сейчас за бесценок продаются на AliExpress.

Очевидно, что Intel было бы совсем не сложно добавить поддержку двухпроцессорности в свои «гражданские» ЦП по типу i5 или i3, как это было с теми же Pentium, а Nvidia и AMD могли бы развивать SLI и CrossFireX соответственно. Но тогда как бы это отразилось на продажах старших моделей линеек процессоров или видеокарт? Люди бы просто вместо «апгрейда» на новое поколение, либо на более мощные версии текущего, покупали бы на БУ-площадках аналогичные ЦП и ГП, вставляли в компьютер и наслаждались за «смешные» деньги приростом производительности в два раза. Но это слишком невыгодно, поэтому технологии «мультиустройств» доступны либо в самых топовых решениях, таких как 3090 и Intel Xeon, либо же вовсе канут в лету уже в ближайшее время, как это сейчас происходит с CrossFireX.